ChatGPT成为欧盟的眼中钉,隐私风险只是表象

ChatGPT到底是第四次工业革命的曙光、仍是是扑灭人类的推手,现在那场关于“生成式人工智能到底是不是潘多拉魔盒”的论战,已然在科技圈如火如荼的停止。就在业界关于生成式人工智能到底是天使仍是魔鬼的争论尚无结论之时,部门欧洲国度似乎先坐不住了。

本地时间3月31日,意大利数据庇护局(Garante)方面公布,从本日起制止利用ChatGPT、限造OpenAI处置该国用户信息,并起头立案查询拜访。

不单单是意大利,随后德国数据专员乌尔里希·凯尔伯(Ulrich Kelber)也表达,德国可能会效仿意大利,以数据平安方面的担忧为由,屏障OpenAI的聊天机器人ChatGPT。而跟着此事的发酵,越来越多欧洲国度也起头考虑对人工智能相关手艺摘取更为严厉的监管。

就在4月13日,西班牙国度数据庇护局颁发声明称,其已经正式对ChatGPT可能的违法行为展开初步伐查。同时,法国国度信息自在委员会(CNIL)也决定对ChatGPT展开查询拜访。不只如斯,欧洲数据庇护委员会(EDPB)还公布成立专门的工做组,以促进针对ChatGPT的查询拜访相关协做事宜。

那些欧洲国度对ChatGPT的不友好立场,几乎都源自隐私平安与数据庇护,而且他们认为ChatGPT那类生成式人工智能的手艺原理处于黑箱形态。好比,Garante方面就要求OpenAI在其官网向意大操纵户公示ChatGPT运行所需数据处置背后的“办法和逻辑”。

展开全文

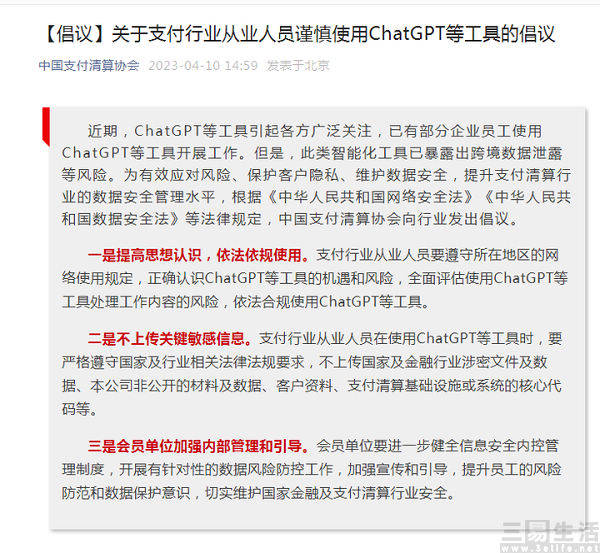

其实ChatGPT会招致数据泄露那一点,此前已经被证明。不久前在三星容许员工利用ChatGPT不敷20天的时候,只是其掌握到的数据泄露事务就已有3起,例如三星DS设备处理计划部分的员工在操做半导体测试设备下载软件的过程中,将相关代码复造到ChatGPT中觅觅谜底。同样亚马逊的律师就警告该公司员工,不要与ChatGPT分享“任何亚马逊的奥秘信息”,因为输进的信息可能会被用做ChatGPT迭代的操练数据。

固然根据OpenAI方面的说法,ChatGPT利用的操练数据可能包罗来自多个来源的“公开可用的小我信息”,而且其所摘取办法庇护用户隐私的体例,包罗“微调”模子以阻遏用户询问小我信息,以及“在可行的情状下”从操练数据中删除用户信息。然而现实情状,却是即使OpenAI没有兴致搜集用户的小我数据,也很难制止那些数据在操练过程被ChatGPT进修。

从手艺角度来说,ChatGPT自己的运做体例难以阐明,它是一种基于统计进修神经收集的黑箱模子,也无法阐明其内部的工做机造,那一点即使是亲身操练ChatGPT的OpenAI研究人员,也无法明白谜底产生的过程,更无法评估其智能水平。

那么ChatGPT的智能事实从何而来,或答应以用凯文· 凯利在《失控》一书中的说法来阐明。即伶俐是涌现而出的,即各个部门遵照简单的趋利避害原则动作,而当群体规模抵达必然水平后,伶俐就突然呈现了。

事实上,当用户利用ChatGPT来搀扶帮助本身更好工做、进修、生活的过程,几乎就无法制止交出小我隐私信息,或者说大语言模子根据输进的内容输出成果的过程,反而是在无时无刻扩展数据泄露的风险。

例如,你需要借助ChatGPT写一个项目停顿陈述,为了让陈述更详实、更可信,就必需要添加关键的数据和逻辑。固然那一操做会让ChatGPT输出的成果更可信,也会让ChatGPT更有动力往进修,以便将来用你的数据往返答其别人的问题。

其实简单来说,“ChatGPT的嘴是没把门的”。当然,隐私平安可能只是部门欧洲国度抵触ChatGPT的外表原因,更深条理的原因或许是从《通用数据庇护条例》(GDPR)到《数字市场法案》一脉相承的理念,即在互联网世界里成立欧盟的数字边陲。

现在在互联网世界中,美国与中国是既得利益者,诸如Facebook、Amazon、Microsoft、Apple、腾讯、阿里巴巴、字节跳动等喊得上号的科技巨头都是来自中美,日本、欧盟则几乎是互联网时代的失意者。

从某种意义上来说,互联网让世界酿成地球村的30年后,欧盟方面末于醒悟过来,在建立初期拔擢本土企业的做法可能才是明智之举,那也使得中国成为了美国之外,独一一个有本身完全互联网生态的国度。要否则在那一轮生成式人工智能的海潮中,中国已经有了文心一言、通义千问的情状下,欧洲为什么就没有属于本身的ChatGPT类产物呢。

事不外三,已经错过了PC互联网与挪动互联网的欧洲,那一次显然不想再落伍了。假设陆续任由ChatGPT肆意攫取欧洲人/企业的相关数据,本土的生成式人工智能可能就实要被消亡在萌芽形态了。