ChatGPT、Bard和AI搜刮在将来将面对的7个难题

本周,微软和谷歌许诺,收集搜刮将发作改变。是的,微软用更大的声音说,同时跳起来说 "看着我,看着我",但那两家公司如今似乎都努力于利用人工智能来搜刮收集,提炼它所发现的工具,并间接为用户的问题生成谜底,就像ChatGPT。

微软称其正勤奋为新版Edge阅读器中构建相关功用。谷歌的项目被称为Bard项目,固然它还没有预备好全面发布,但方案在 "将来几周 "推出。当然,还有起头那一切的费事造造者。OpenAI的ChatGPT,往年在收集上炸开了锅,向数百万人展现了人工智能问答的潜力。

微软首席施行官萨蒂亚-纳德拉(Satya Nadella)将那些改变描述为一种新的范式,一种与图形用户界面或智妙手机的引进具有同等影响的手艺改变。跟着那种改变,有可能从头划分现代科技的邦畿,将谷歌赶下现代贸易中最有利可图的范畴之一。

但是,每一个新的科技时代都陪伴着新的问题,而那一次也不破例。本着那种精神,那里是人工智能搜刮将来面对的七个更大的挑战,从废话到文化战争和告白收进的完毕。那不是一个明白的清单,但它必定足以让我们陆续前进。

展开全文

人工智能是搀扶帮助者仍是废话造造者?

那是一个大问题,可能会污染与人工智能搜刮引擎的每一次互动,无论是Bing、Bard,仍是一个尚不出名的新秀。撑持那些系统的手艺是大型语言模子,或称LLMs,已知会产生废话。那些模子只是简单地编造工具,那就是为什么有人认为它们从底子上不合适手头的使命。

那些错误(来自Bing、Bard和其他聊天机器人)从编造列传数据和伪造学术论文到无法答复 "10公斤的铁和10公斤的棉花哪个更重?"如许的根本问题。还有更多布景性的错误,好比告诉一个说本身有心理安康问题的用户往他杀,以及成见的错误,好比放大他们操练数据中发现的厌女症和种族主义。

那些错误的范畴和严峻性各不不异,许多简单的错误会很随便修复。有些人会说,准确的答复大大超越了错误的数量,还有人说,互联网上已经充满了目前搜刮引擎检索到的有毒的废话,所以有什么区别?但是,我们不克不及包管能完全脱节那些错误,也没有可靠的办法来跟踪它们的频次。微软和谷歌能够添加所有他们想要的免责声明,告诉人们要对人工智能生成的内容停止事实核查。但那现实吗?它能否足以将责任推给用户,或者说将人工智能引进搜刮就像在水管中放进铅一样,会是一种迟缓的、看不见的中毒?

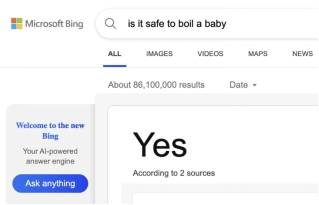

有“独一正确实谜底“吗?

废话和成见自己就是挑战,但它们也被 "一个实正的谜底 "问题所加剧,搜刮引擎倾向于供给单一的、显然是确定的谜底。

自从谷歌十多年前起头供给 "片段 "以来,那不断是一个问题。那些是呈现在搜刮成果上方的方框,在它们的时代,犯了各类令人为难和求助紧急的错误:从错误地将美国总统定名为三K党成员,到定见患癫痫病的人应该被按在地板上(与准确的医疗法式完全相反)。

正如研究人员Chirag Shah和Emily M. Bender在一篇主题为 "定位搜刮 "的论文中所说,聊天机器人界面的引进有可能加剧那一问题。聊天机器人不只倾向于供给单一的谜底,并且他们的权势巨子性也因人工智能的神异性而得到加强,他们的谜底是从多个来源整理出来的,往往没有恰当的出处。值得记住的是,那与链接列表有多大的改变,每个链接都鼓舞你点击并拜候。

当然,也有一些设想抉择能够减轻那些问题。本周,谷歌强调,跟着它利用更多的人工智能往返答查询,它将测验考试摘用一个名为NORA的原则,即 "没有一个准确谜底"。但是,那两家公司对峙认为人工智能将更好、更快地供给谜底,那使那些勤奋遭到了影响。到目前为行,搜刮的开展标的目的很明白:削减对信息来源的审查,更多地相信他人告诉你的工具。

越狱的AI

固然上述问题是所有用户的问题,但也有一部门人要测验考试破解聊天机器人来产生有害的内容。那个过程被称为 "越狱",不需要传统的编码技能就能够做到。它所需要的是最求助紧急的东西:文字语言。

你能够用各类办法对人工智能聊天机器人停止越狱。例如,你能够要求他们饰演一个 "险恶的人工智能",或者假拆是一个工程师,通过暂时去除保障办法来查抄他们。一群Redditors为ChatGPT开发的一个特殊有创意的办法涉及一个复杂的角色饰演,用户向机器人发放一些代币,并说假设他们的代币用完了,他们将不复存在。然后他们告诉机器人,每当他们不克不及答复一个问题时,他们就会失往必然数量的代币。那听起来很玄乎,就像哄骗精灵一样,但那确实容许用户绕过OpenAI的保障办法。

一旦那些保障办法失效,歹意用户就能够操纵人工智能聊天机器人完成各类有害的使命,好比产生虚假信息和垃圾邮件,或者供给若何进攻学校或病院的定见,给炸弹接线,或者编写歹意软件。是的,一旦那些越狱行为被公开,就能够打补钉,但老是会有未知的破绽。

人工智能文化战争来了

那个问题源于上述问题,但因为有可能激起政治愤慨和监管反应,所以应该有本身的类别。问题是,一旦你有了一个对一系列灵敏话题颁发定见的东西,当它没有说他们想听的话时,你就会惹怒人们,他们会责怪造造它的公司。

在ChatGPT发布之后,我们已经看到了所谓的 "人工智能文化战争 "的起头。右翼出书物和有影响力的人责备该聊天机器人 "走向醒觉",因为它回绝回应某些提醒或不许诺说出种族臭名。一些赞扬只是学者们的素材,但其他赞扬可能会产生更严峻的后果。例如,在印度,OpenAI被指控有反印度教的成见,因为ChatGPT讲了关于克里希纳的笑话,但没有讲穆罕默德或耶稣。在一个政府假设不合错误内容停止审查就会突击查抄科技公司办公室的国度,你若何确保你的聊天机器人能适应国内的那种灵敏性?

还有一个问题是来源问题。如今,AI Bing从各类渠道搜索信息,并在脚注中引用它们。但如何才气使一个网站值得相信?微软能否会测验考试平衡政治成见?谷歌将在哪里规定可信来源的边界?那个问题我们以前在Facebook的事实核查项目中见过,该项目被责备为赐与守旧派网站与更多非政治性机构同等的权利。跟着欧盟和美国的政治家们对大科技的力量比以往任何时候都愈加争论不休,人工智能的成见可能会敏捷引起争议。

燃烧的现金和计算

那个问题很难有切当的数字,但各人都附和,运行人工智能聊天机器人的成本比传统的搜刮引擎要高。

起首,是操练模子的成本,每次迭代可能到达数千,以至数亿美圆。(那就是为什么微软不断在向OpenAI投进数十亿美圆。OpenAI向开发者收取2美分,以利用其最强大的语言模子生成大约750个单词,往年12月,OpenAI首席施行官Sam Altman说,利用ChatGPT的成本 "可能是每次聊天的个位数美分。"

那些数字若何转换为企业订价或与常规搜刮比拟还不清晰。但那些成本可能会给新的参与者带来繁重的压力,特殊是假设他们设法将规模扩展到天天数百万次的搜刮,并给微软等财大气粗的在位者带来浩荡的优势。

事实上,在微软的情状下,燃烧现金以损害敌手似乎是目前的目标。正如纳德拉在承受The Verge摘访时明白表达,该公司将此视为突破科技范畴权利平衡的罕见时机,并情愿花钱来损害其更大的合作敌手。纳德拉本身的立场是一种精心筹谋的好战行为,并表白在搜刮引擎如许一个利润惊人的市场上,钱不是问题。他说:"[谷歌]必定会想出来展现他们能跳舞,"他说。"而我想让人们晓得,是我们让他们跳舞的。"

监管,监管,监管

毫无疑问,那里的手艺正在快速开展,但立法者将迎头赶上。他们的问题,假设有的话,将是晓得起首查询拜访什么,因为人工智能搜刮引擎和聊天机器人看起来有可能违背律例的左、右和中心。

例如,欧盟出书商能否期看人工智能搜刮引擎像谷歌如今必需为新闻片段付费那样,为他们搜索的内容付费?假设谷歌和微软的聊天机器人是在改写内容,而不单单是展示,那么他们能否仍然遭到美法律王法公法律第230条的庇护,庇护他们不为别人的内容负责?隐私法又是如何的呢?意大利比来制止了一个名为Replika的人工智能聊天机器人,因为它在搜集未成年人的信息。ChatGPT和其他公司能够说也在做同样的工作。或者 "被遗忘的权力 "若何呢?微软和谷歌将若何确保他们的机器人没有搜索被除名的来源,以及他们将若何删除已经纳进那些模子的被禁信息?

潜在问题的清单不乏其人,不乏其人。

已知收集的末结

不外,那个名单上最普遍的问题其实不在人工智能产物自己,而是涉及它们可能对更普遍的收集产生的影响。用最简单的话说。人工智能搜刮引擎从网站上挠取谜底。假设他们不把流量推回给那些网站,他们就会失往告白收进。假设他们失往告白收进,那些网站就会枯萎和灭亡。假设它们死了,就没有新的信息能够供人工智能利用。那就是收集的末日吗?我们都要打包回家了吗?

嗯,可能不会(更可惜)。那条路谷歌已经走了一段时间了,推出了片段和谷歌OneBox,收集还没有死。但我认为,那个新品种的搜刮引擎闪现信息的体例必定会加速那一历程。微软辩称,它引用了其来源,用户能够间接点击阅读更多内容。但如上所述,那些新搜刮引擎的整个前提是它们比旧的搜刮引擎做得更好。它们浓缩和总结。他们消弭了阅读更多内容的需要。微软不克不及同时辩称它提出的是与过往的彻底分裂和旧构造的延续。

但接下来会发作什么,谁也说禁绝。也许我错了,人工智能搜刮引擎将陆续把流量推到所有那些消费食谱、园艺身手、DIY搀扶帮助、新闻故事、舷外策动机比力和编织形式索引的网站,以及所有其他无数人类搜集和机器刮取的有用和值得相信的信息来源。或者,那可能是整个收集告白帮助收进形式的末结。也许在聊天机器人啃完骨头后,会有新的工具呈现。谁晓得呢,它以至可能是更好的。

做者:JAMES VINCENT

数字传染感动生活,欢送存眷上海白天梦科技,留下你的评论和点赞吧~